Apple Privacy Model und Confidential Computing

In seiner jüngsten Ankündigung hat Apple begonnen, mehr KI-Funktionen für sein Ökosystem einzuführen. Einer der interessantesten Aspekte war das Konzept des Private Cloud Compute.

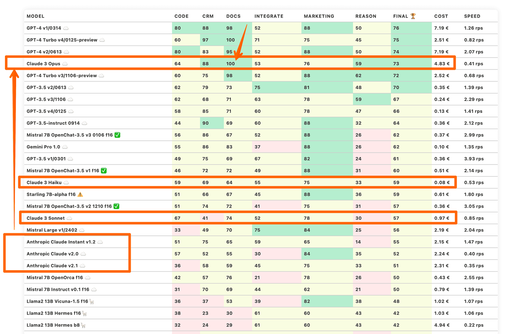

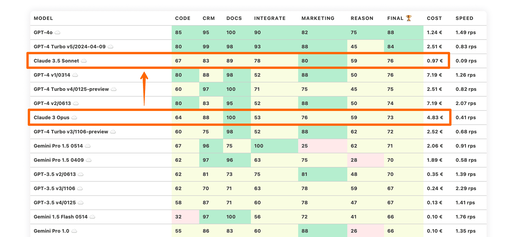

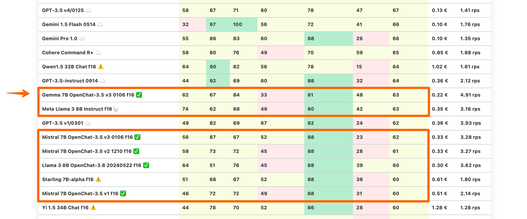

Im Wesentlichen wird das iPhone ein kleines und effizientes LLM-Modell verwenden, um alle eingehenden Anfragen zu bearbeiten. Dieses LLM ist nicht sehr leistungsfähig und vergleichbar mit modernen 7B-Modellen. Es ist jedoch schnell und verarbeitet alle Anfragen auf sichere Weise lokal.

Besonders interessant wird es, wenn das LLM-gesteuerte System erkennt, dass es mehr Rechenleistung benötigt, um die Anfrage zu bearbeiten.

In diesem Fall hat es zwei Optionen:

Es kann den Benutzer um Erlaubnis bitten, die spezifische Anfrage an OpenAI GPT zu senden.

Es kann die Anfrage auf sichere Weise an eine von Apple verwaltete Private Cloud Compute weiterleiten.

Was ist Private Cloud Compute?

Es handelt sich um ein geschütztes Apple-Rechenzentrum, das eigene Chips verwendet, um leistungsstarke Large Language Models zu hosten. Diese Einrichtung bietet starke Garantien dafür, dass Ihre persönlichen Anfragen sicher bearbeitet werden und niemand, nicht einmal Apple, die Fragen und Antworten einsehen kann.

Dies wird durch eine Kombination aus spezieller Hardware, Verschlüsselung, gesicherten VM-Images und gegenseitiger Beglaubigung zwischen Software und Hardware erreicht. Letztendlich tun sie ihr Bestes, um es selbst für Apple oder Regierungen sehr schwierig und kostspielig zu machen, dieses System zu durchbrechen.

Bei Apple dreht sich alles um Unterhaltungselektronik, gibt es etwas Vergleichbares für Unternehmen?

Ja, das gibt es. Es nennt sich Confidential Computing. Das Konzept gibt es schon seit einiger Zeit (siehe das Confidential Computing Consortium), wurde aber erst kürzlich von Nvidia auf GPUs richtig angewendet. Nvidia führte es in der Hopper-Architektur (H100 GPUs) ein und eliminierte fast vollständig die Leistungseinbußen in der Blackwell-Architektur.

Das Konzept ist dasselbe wie bei Apples PCC:

Daten werden während der Übertragung und im Ruhezustand verschlüsselt

Daten werden während der Berechnungszeit entschlüsselt

Hardware und Software sind so gestaltet, dass es unmöglich (wirklich schwierig und teuer) ist, die Daten während der Entschlüsselung anzusehen.

Große Cloud-Anbieter testen bereits VMs mit vertraulicher GPU-Berechnung (z. B. Microsoft Azure mit H100 seit 2023, Google Cloud mit H100 seit 2024).

Dieser Ansatz ist interessant, weil er Unternehmen, die ein sicheres LLM-gesteuertes System aufbauen müssen, eine dritte Option bietet: